【1-bit Bonsai 8B を CPU で動かしてみた!】Ryzen 5 3600 × 32GB RAM 検証

こんにちは、ペスケです。

AI楽しんでますか?

今日はですね、「1-bit Bonsai 8B」っていう、ちょっと変わったAIを、うちのパソコン(Ryzen 5 3600、メモリ32GB、GPUなし)で動かしてみた回になります。

「1-bit」って何?って思う人も多いと思うんですけど、要は めちゃくちゃ軽くなる新しいAIのしくみ です。今日はそれを実際に試してみて、どうだったかっていうお話をしていきます。

今日の流れ

ざっくりこんな感じで進めていきます。

- まず Bonsai 8Bってどんなやつ? っていう話

- 次に パソコンに入れるまで の話(ここ、ちょっとハマりました)

- それから 3本の検証。歌詞を書かせたり、ブログ下書きを読ませたり、マルチAgentに組み込んだり

- 最後にまとめ

よろしくお願いします。

Bonsai 8Bってなに?

まず、そもそも Bonsai って何?って話なんですけど。

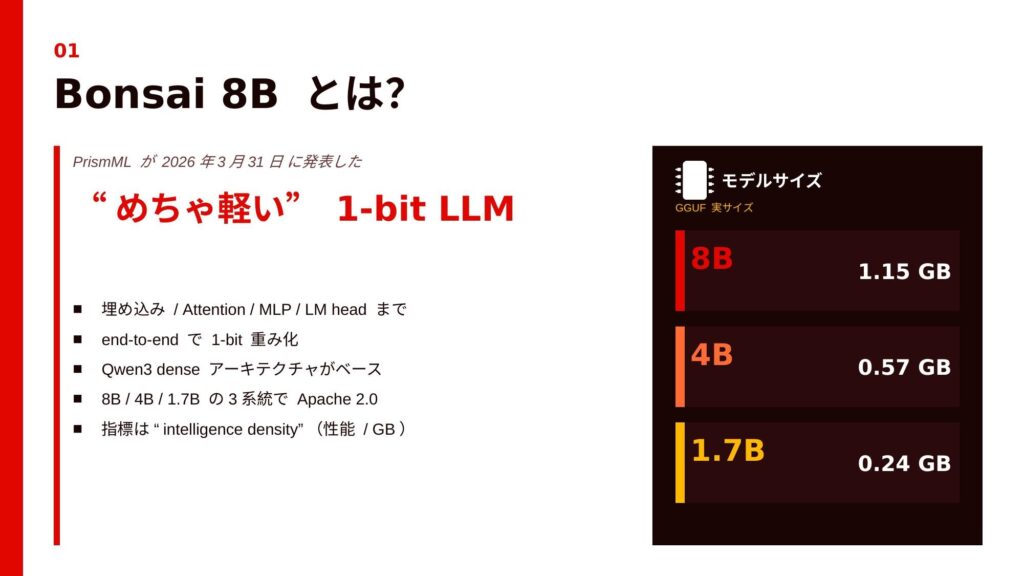

PrismML っていう会社が 2026年3月31日 に出した、1-bit のLLM です。

ふつうのAIって、中身の重みを細かく細かく覚えてて、その分ファイルが重いんですよ。Bonsai は、その重みを 1 か 0 かの2択まで減らしちゃう 。だから、ファイルがすごく小さくなる。

しかも埋め込みも、Attention も、MLP も、LM head まで、end-to-end で全部 1-bit に振り切ってます。ベースは Qwen3 の dense アーキテクチャです。

サイズ見てもらうとわかりやすいんですけど、

- 8B が約 1.15GB

- 4B が 0.57GB

- 1.7B にいたっては 0.24GB

これね、普通のAIの10分の1くらい のサイズです。ほんとにスマホに入っちゃうレベル。

しかも 8B / 4B / 1.7B の3系統、全部 Apache 2.0 っていう、誰でも使っていいライセンスで出てます。太っ腹ですね。

PrismML が推してる指標が “intelligence density“、つまり 1GBあたりどれだけ賢いか っていう考え方なんですけど、これが今回の話のキモになってきます。

8Bの立ち位置

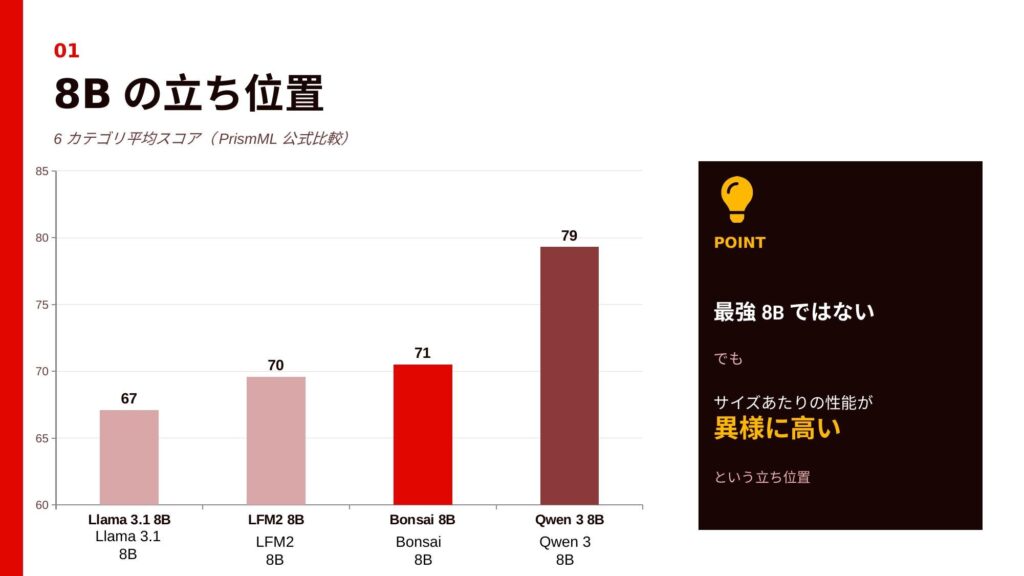

じゃあ「軽いだけで賢くないんじゃないの?」って話なんですけど。

PrismMLの公式の比較表、これが6個のテストの平均点です。

- Llama 3.1 8B が 67点

- LFM2 8B が 69.6点

- Bonsai 8B が 70.5点

- Qwen 3 8B が 79.3点

つまり Bonsai 8B は、トップではないけど、真ん中よりちょっと上 のポジション。

でもここで大事なのは、さっきの サイズあたりの賢さ なんですよ。ファイルが10分の1なのに、同じサイズの他のAIと張り合えてる。これが面白い。

「じゃあ最強なの?」って言われたら「違う」。でも、小さいのに頭いい、そこが Bonsai のポイントです。

※この数字は PrismML の自己評価なので、そこは割り引いて見てください。ただ独立ベンチマークでもだいたい同じ評価が出てるようです。

スピードも結構すごい

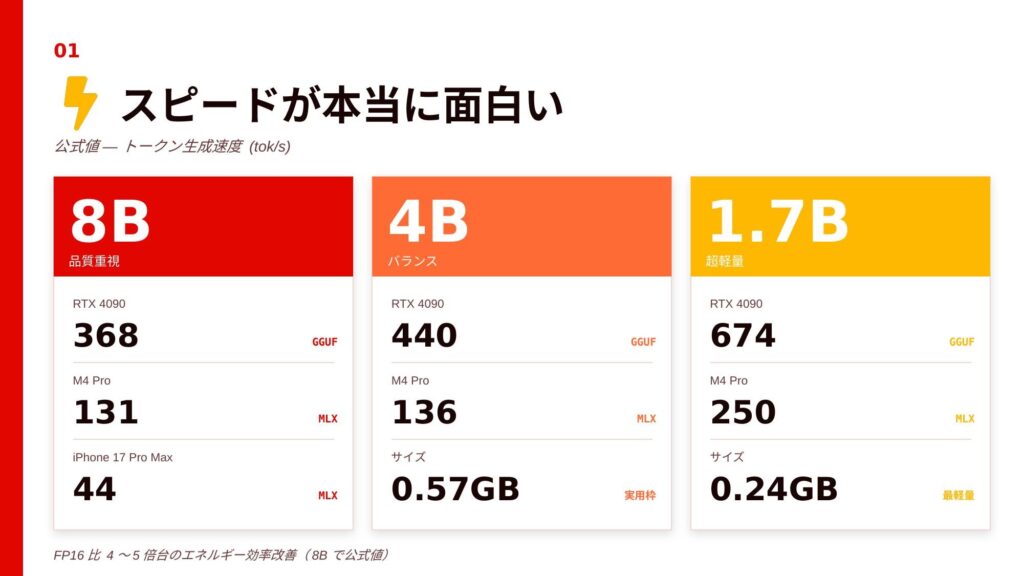

そしてスピードも結構すごいです。

これは1秒間に何トークンくらい出せるかっていう速さなんですけど、公式の数字だと、

- 8B でも、RTX 4090 で 1秒に 368 tok/s

- M4 Pro で 1秒に 131 tok/s

- なんと iPhone 17 Pro Max でも 1秒に 44 tok/s

iPhone で動く 8B のAIって、ちょっと前までは考えられなかったんですよ。

4B や 1.7B はもっと速くて、1.7B だと RTX 4090 で 1秒 674 tok/s。もう目で追えないです。

電気の消費も、ふつうの FP16 と比べて 4〜5倍くらい省エネ になるらしいです(8Bの公式値)。

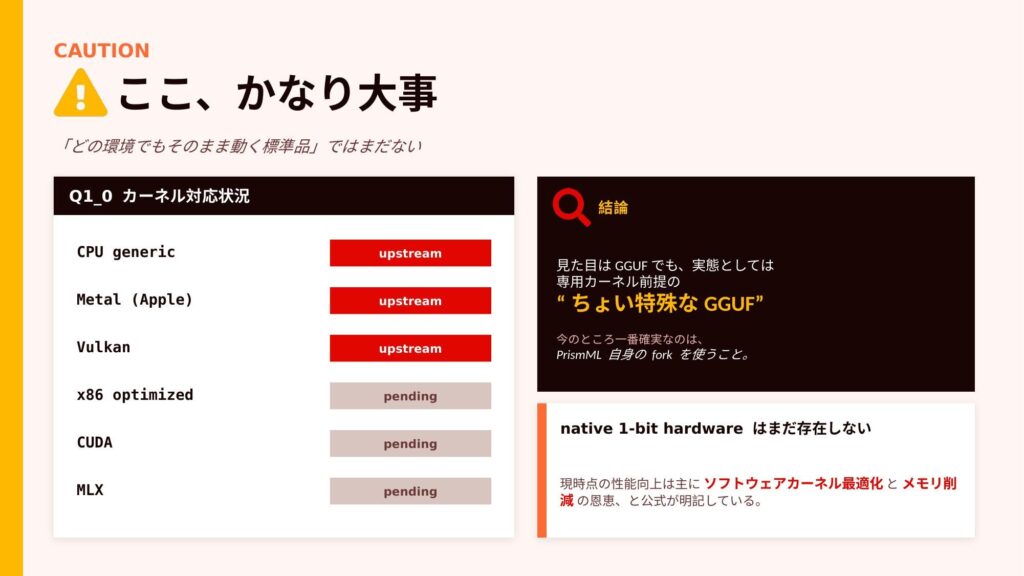

ここ、かなり大事な注意点

ただ、ここ 結構大事な注意点 があって。

「1-bitのAIだから、どのパソコンでもサクッと動くんでしょ?」って思うじゃないですか。

まだそうじゃない んですよ。

今のところちゃんと動くのは、

- CPU generic(普通のCPU)

- Metal(Apple Silicon)

- Vulkan

この3つだけ。x86 最適化、CUDA、MLX は まだ pending です。

Vulkanってそもそも何?

ここ、ちょっと補足させてください。配信に来てくれる人、AMDユーザー多いと思うので。

Vulkan(バルカン)っていうのは、GPUで計算させるためのAPI です。AMD も NVIDIA も Intel も、メーカーを選ばず動く共通規格 なんですよ。

で、AMDのGPUで AI を動かそうとすると、普通は ROCm(ロックエム) っていう AMD公式のやつを使うんですけど、これがまた 対応カードが少なくて、設定もややこしい。うちの RX 570 とか、古めのカードはもう ROCm サポート外なんです。

そこで Vulkan の出番 です。

実は llama.cpp に Vulkan バックエンドがあって、これを使うと 古い RX 580 とか RX 570 でも GPU で AI が動く んですよ。ROCm より設定も楽で、最近は 性能も ROCm と肩を並べるか、場合によっては超えてくる くらいになってきてます。

つまり今回の Bonsai の話に戻すと、Vulkan 対応してるってことは、理論上うちの RX 570 でも GPU で動く可能性がある ってことなんです。これデカい。

もうひとつ大事な話

あと、見た目は GGUF っていう一般的なファイル形式なんですけど、実は 専用カーネル前提の “ちょっと特殊な GGUF” だと思ってください。

今のところ一番確実なのは、PrismML 自身が出してる fork 版を使うこと。

それと、「1-bitだから理論上もっと速いはず」って言う人もいるんですけど、今のところ 1-bit 専用のハードはまだこの世に存在しません。速くなってるのは、ソフトのカーネル最適化とメモリ削減の恩恵、っていうのは公式も明記してるので、頭の片隅に置いといてください。

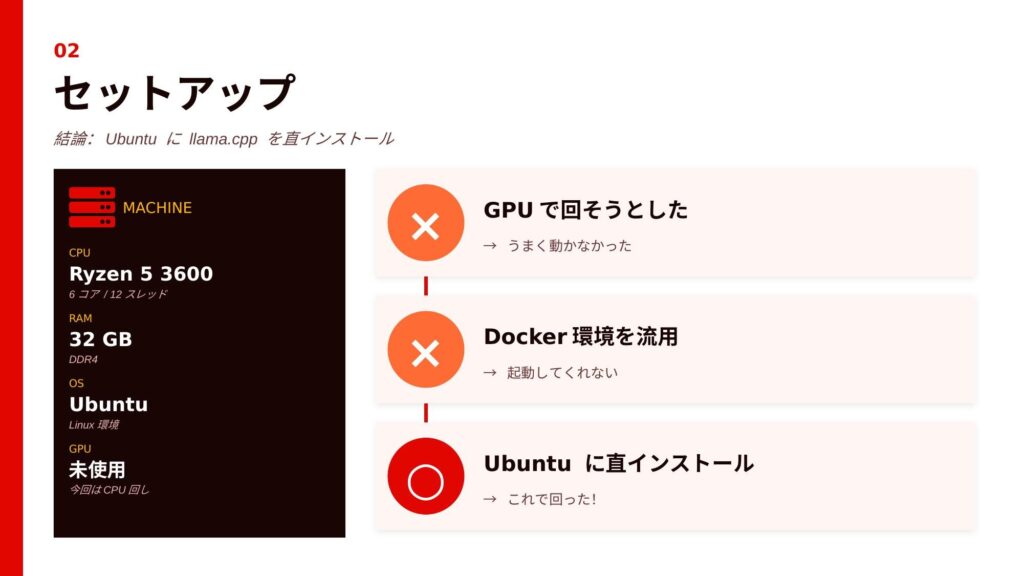

セットアップ(ここハマりました)

で、実際に入れる話です。

うちのマシンは、

- CPU:Ryzen 5 3600(6コア / 12スレッド)

- メモリ:32GB DDR4

- OS:Ubuntu

- GPU:今回は使わない(CPU回し)

で、最初 GPU で動かそうとしたんですけど、ダメでした。

次に、前に紹介した Docker の環境でやろうとしたんですけど、これも起動してくれない。

ネットで調べたら「直接インストールしたほうがいい」って話が出てきたので、Ubuntu に llama.cpp を 直で入れました。そしたら動いた。

なので今回は、Docker じゃなくて直インストール でやってます。

3本の検証

じゃあ実際に何をさせたかっていうと、3つやりました。

- CREATIVE — 面白い歌詞を書かせてみる

- DOCUMENT — 自分のブログの下書き(Markdown)を読ませる

- AGENT — 戦国討論Bot(マルチAgent)に組み込んでみる

ひとつずつ見ていきます。

検証1:面白い歌詞を書かせてみた

まずはクリエイティブ系。

1-bit のモデルで、どこまで遊べるか っていう素直なテストです。

今回のプロンプトはこんな感じ。

[りんご]で面白い歌詞を考えてください。

j-pop で明るい恋愛ソングにしてください。

こんな感じでザックリ投げてみました(笑)

で、返ってきたのがこれ。

## 🎶 タイトル:「にんぎりの季節」

ジャンル:J-Pop / レインボー恋愛

テーマ:青春、希望、心の温かさ

---

### Verse 1

「にんぎりの季節、空が赤く輝く

心を浮かべて、あなたを届ける

笑顔が広がる、この季節に

心を捧げる、あなたを信じる」

### Pre-Chorus

「あなたが笑うとき、世界が静かな

心が跳ねるとき、その光が明るい

にんぎりの季節、私の心に

あなたの声が響く、その瞬間を」

### Chorus

「にんぎりの季節、心をつなぐ

あなたが手を出すとき、私は飛ぶ

この季節に、あなたとなら

心ににんぎりの季節が広がる」

(Verse 2 / Pre-Chorus / Chorus / Bridge / Outro 省略)

Code language: PHP (php)…はい。

一部省きましたけど、ちょっと謎な歌詞 を書いてくれました。

「にんぎりの季節」ってなんでしょうね(笑)

僕は、りんご って指定したんですけどね(笑)

「青春、希望、心の温かさ」みたいにテーマの骨格はちゃんと押さえてくるし、Verse / Pre-Chorus / Chorus の構成も J-Pop っぽくて、構成を組む力は思ったよりある 。

ただ中身の整合性は、もうちょっと人間側で修正が必要ですね。

ちなみに音楽生成は Suno AI で後から乗せました。

生成速度は 904 tokens / 51秒 / 17.53 t/s。CPU回しでこれなら、結構速くてびっくりします。

検証2:自分のブログの下書きを読ませてみた

次に、以前書いたブログ記事の下書きの Markdown ファイル を渡してみました。

もう投稿済みの記事(モンハンカフェ行ってきた、ってやつ)の下書きを使ってます。

プロンプトは「このマークダウンファイルをブログ記事にしてください」。

渡した下書きは、末尾にリンクを貼っておくので、まだ見てない方はぜひそっちも覗いてみてください。

で、返ってきたのがこれです。一部抜粋。

Blog記事:

「友達とモンハンカフェに行ってみた!」

はじめまして、皆様!

ペスケです。今回は、去年の年末に大阪で、

友達とモンハンカフェに足を運びました。

ゲームの時間が過ぎたという感覚で、

大阪にいる間に、何か楽しいことをしたいと思っていました。

その中、モンハンカフェは、

とてもおすすめの場所 emerged ました。

---

なぜモンハンカフェ?

モンハンカフェは、「コラボカフェ」として知られています。

ゲームの体験や、モンスター、道具、服など、

すべての要素が再現されています。

ゲームの世界観を、実感できる体験へとつなぐのが

とても魅力的です。

(中略)

行き方

アパホテルは、肥後橋駅にあります。

そこから電車で「難波」(電車の停止や遅れ)に乗りたくなるので、

注意が必要です。

行き方のポイント:

- アパホテルから電車に乗ると、電車の停止が起きます。

- 電車が停止した後、土日には予約制がありますので、予約が必須です。

- 電車が動き出す前に、ホームに降りて、

トンネルの地下にある「B26番」に降りて、少し歩くことで、

「トンネルの出口」が見つかります。

…はい(笑)

まず「emerged ました」って何(笑)

あと「電車の停止が起きます」「トンネルの地下にある B26番」とか、もはや怪文書です。

構成はブログっぽく組んでくれてるんですよ。タイトル、リード、見出し、タグ付け、投稿日まで。テンプレの再現はちゃんとできてる。

ただ、中身の事実関係と日本語の自然さ は、僕が書いたオリジナルと比較しても全然別物になってます。特に固有名詞の扱いと、「〜しました」系の接続は崩れやすいっぽいですね。

実用的には、ブログを丸ごと書かせるのはまだまだ、っていう感じ。下書きのアイデア出しとか、テンプレ起こしくらいの用途なら使える、くらいの手触りです。

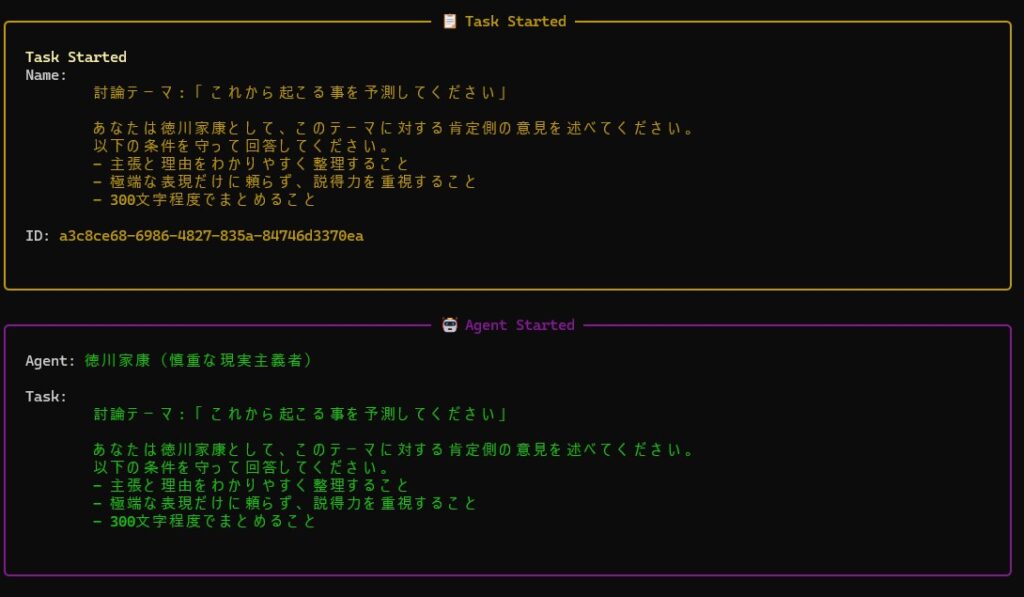

検証3:戦国討論Botに組み込んでみた

最後がこれ、一番やりたかったやつです。

前に Claude と一緒に作った 戦国時代の武将たちに議論させるマルチAgent があるんですけど、そこのモデルを Bonsai 8B に差し替えてみました。

今回呼び出した武将は、

- 徳川家康

- 豊臣秀吉

- 織田信長

の3人。で、まとめ役として 論破王 も召喚して、最後に論点をまとめてもらう、っていう設計です。

言語は Python、フレームワークは CrewAI 。

プログラムは GitHub にアップしてあるので、気になる人は末尾からどうぞ。

テーマは、「AI時代これから起こる事を予測してください」。

あえてフワッと濁して作りました。

動作の様子は、まずターミナルで確認できて、終わると Discord に結果が飛んでくる、っていう流れ。

テスト段階のログしか画像が無かったのですみません。

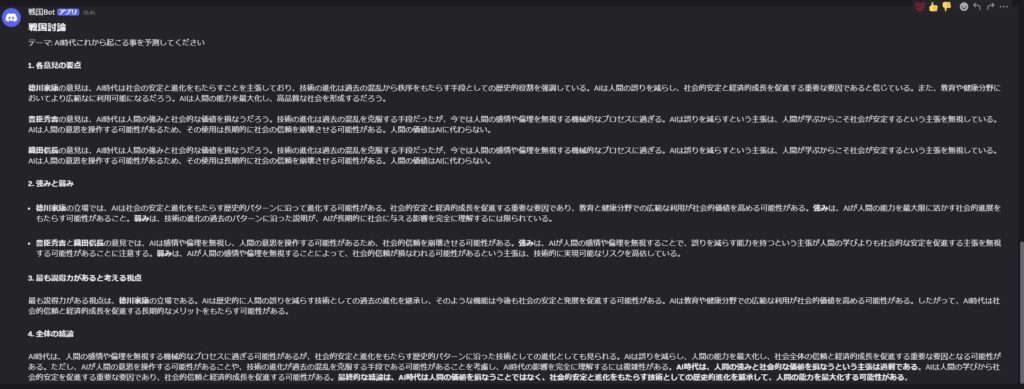

で、返ってきた議論がこちら。

## 戦国討論

テーマ:AI時代これから起こる事を予測してください

1. 各意見の要点

徳川家康 の意見は、AI時代は社会の安定と進化をもたらすことを

主張しており、技術の進化は過去の混乱から秩序をもたらす手段

としての歴史的役割を強調している。AIは人間の誤りを減らし、

社会的安定と経済的成長を促進する重要な要因であると信じている。

豊臣秀吉 の意見は、AI時代は人間の強みと社会的な価値を

損なうだろう。技術の進化は過去の混乱を克服する手段だったが、

今では人間の感情や倫理を無視する機械的なプロセスに過ぎる。

AIは人間の意思を操作する可能性があるため、その使用は

長期的に社会の信頼を崩壊させる可能性がある。

織田信長 の意見は、AI時代は人間の強みと社会的な価値を

損なうだろう。技術の進化は過去の混乱を克服する手段だったが、

今では人間の感情や倫理を無視する機械的なプロセスに過ぎる。

AIは人間の意思を操作する可能性があるため、その使用は

長期的に社会の信頼を崩壊させる可能性がある。

Code language: PHP (php)…気づきました?

秀吉と信長、言ってることまるっきり同じ なんですよ(笑)

プロンプトの中に口調とかキャラ設定も入れてあるんですけど、それもあんまり反映されてない。

いろいろ調べてみたら、これは今回のモデルの影響みたいで、軽いモデルほどキャラの口調や立場の差別化が難しい っていう傾向があるらしいです。

あと、全員同じモデルで回してるのもダメですね。

役割ごとに違うモデルを交互に使い分ける仕組み を作る必要がありそうだな、って気づきました。

最終的なまとめ部分(論破王が書いた結論)は一応こう。

4. 全体の結論

AI時代は、人間の感情や倫理を無視する機械的なプロセスに

過ぎる可能性があるが、社会的安定と進化をもたらす

歴史的パターンに沿った技術としての進化としても見られる。

AIは誤りを減らし、人間の能力を最大化し、

社会全体の信頼と経済的成長を促進する重要な要因となる可能性がある。

最終的な結論は、AI時代は人間の価値を損なうことではなく、

社会的安定と進化をもたらす技術としての歴史的進化を継承して、

人間の能力を最大化する可能性がある。

まとめ役としては、意外とちゃんと両論併記してくれてます。骨組みを作る能力はある 、これは収穫。

なかなか面白い結果だったんじゃないかなと思ってますが、みなさんはどう思いますか?

まとめ

じゃあ最後にまとめです。

思ってたより、ちゃんとした日本語が出てきました。

これ正直ちょっとびっくりです。「1-bit」って聞くと、カクカクした不自然な文章が出てきそうなイメージあるじゃないですか。全然そんなことなかった。

なかなか良いモデル ですよ、これは。

ただ、ブログを丸ごと書かせたり、歌詞の整合性を取らせたり っていう、意味の整合性が強く問われるタスク は、まだまだ厳しい印象でした。ここは正直に言っておきます。

今回の気づきは2つ。

ひとつめ:手触りの良さ

Ryzen 5 3600 と 32GB のメモリでサクッと動く。

GPU無しでもここまでいけるのは強いです。古めのマシン持ってる人、動かす気がなくても一回触ってみる価値ある、レベル。

ふたつめ:次の一手

今回のマルチAgentで気づいたんですけど、プロンプトがかなり雑 でした(笑)

ここをちゃんと作り込めば、もっと精度上がると思います。

あと、役割ごとにモデルを変える っていうのも次やりたい。

次の配信で、そこをブラッシュアップしたやつ、やりたいですね。

リンク集

- 戦国討論Bot(GitHub)

https://github.com/pesche012/sengoku-ronpa - モンハンカフェ行ってきた記事(下書きの元)https://pescheblog.com/monsterhunter-cafe-osaka/

- Bonsai 8B 公式(PrismML)

https://prismml.com/

最後まで読んでいただき、ありがとうございました。