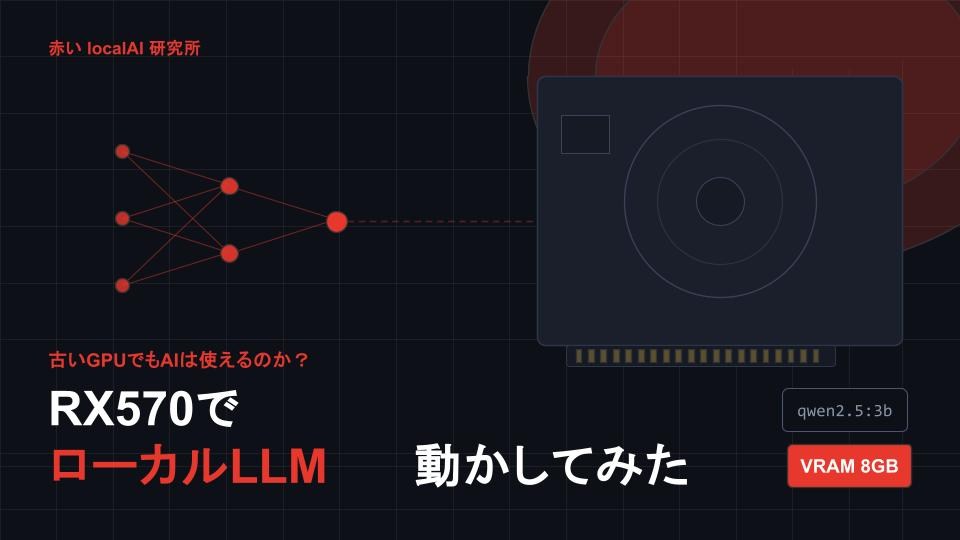

RX570でローカルLLMを動かしてみた!古いGPUでもAIは使えるのか?

みなさんこんにちわ

ペスケです。

みなさんは、「古いGPUでもローカルLLMって動くの?」そんな疑問を持ったことはありませんか?

今回は手元にあった Radeon RX570 8GB を使って、実際にローカルLLMを動かせるか検証してみました。結論から言うと動きます。

ただし、知っておくべきポイントがいくつかあります。

検証マシンのスペック

| パーツ | スペック |

|---|---|

| CPU | Ryzen 5 3600 |

| RAM | 32GB DDR4 |

| ストレージ | SATA SSD 250GB |

| GPU | Radeon RX570 8GB |

| 電源 | 550W |

| OS | Ubuntu Server |

注目すべきはGPU。RX570は2017年発売で、もはや「古参」と呼んで差し支えない世代です。

最新のRTX 4090とは比べるべくもありませんが、VRAMが8GBあるこれが今回のカギになります。

動かしたモデル:Qwen 2.5 3B

今回使用したモデルは qwen2.5:3b(パラメータ数30億)。

Alibaba開発の最新世代LLMで、日本語の精度が高いことでも知られています。

3Bモデルなら8GBのVRAMに十分収まるため、RX570でも動作が見込めるサイズ感です。

構成ツール:Ollama + Open WebUI

ローカルLLM環境の構築には、以下の2つを組み合わせました。

Ollama はローカルでLLMを実行するためのランタイムで、モデル管理やAPIサーバー機能を備えています。Open WebUI はChatGPTライクなブラウザUIで、Ollamaと連携してチャット形式でAIと会話できます。

Docker Composeでまとめて構築できるよう、構成一式をGitHubで公開しています。

👉 GitHub: RX570-ollama-openwebui-stack

AMD GPU(RX570)で動かす際の注意点

NVIDIAのGPUと違い、AMD GPUでOllamaを使うにはいくつかハードルがあります。

ROCmが必須。 AMDのGPUコンピューティング基盤であるROCmが必要です。

Ollamaが対応しているバージョンをしっかり確認しましょう。

Linux(Ubuntu Server)推奨。 ROCmのドライバサポートはLinuxが本命。

Windows環境では対応が限定的です。

速度はNVIDIAに劣る。

同スペック帯のNVIDIA GPUと比較すると、推論速度は遅くなる傾向があります。

3Bモデルが現実ライン。

8GBのVRAMでは7Bモデルは厳しく、3Bモデルが快適に動作するボーダーラインです。

実際に使ってみた感想

応答速度は最新GPUと比べると遅く感じる場面もあります。

しかし、ローカルで完全にプライベートなAI環境を持てるというメリットは大きい。

クラウドAPIに毎月お金を払い続けるよりも、手持ちの古いPCを再活用する選択肢として十分アリだと感じました。

「まず試してみる」第一歩としては理想的な構成です。

まとめ

| 項目 | 評価 |

|---|---|

| 動作可否 | ✅ 動く |

| 推奨モデルサイズ | 3B以下 |

| 実用性 | △ 速度に妥協が必要 |

| コスパ | ◎ 古いGPUの再活用に最適 |

「新しいGPUを買う予算はないけど、ローカルAIを試してみたい」──そんな方にとって、今回の構成はひとつの答えになるはずです。

構築手順の詳細はGitHubのREADMEをチェックしてみてください。